PRENSA IBERO

AUTOR

Jorge Luis Cortés

Reportero de la Dirección de Comunicación Institucional

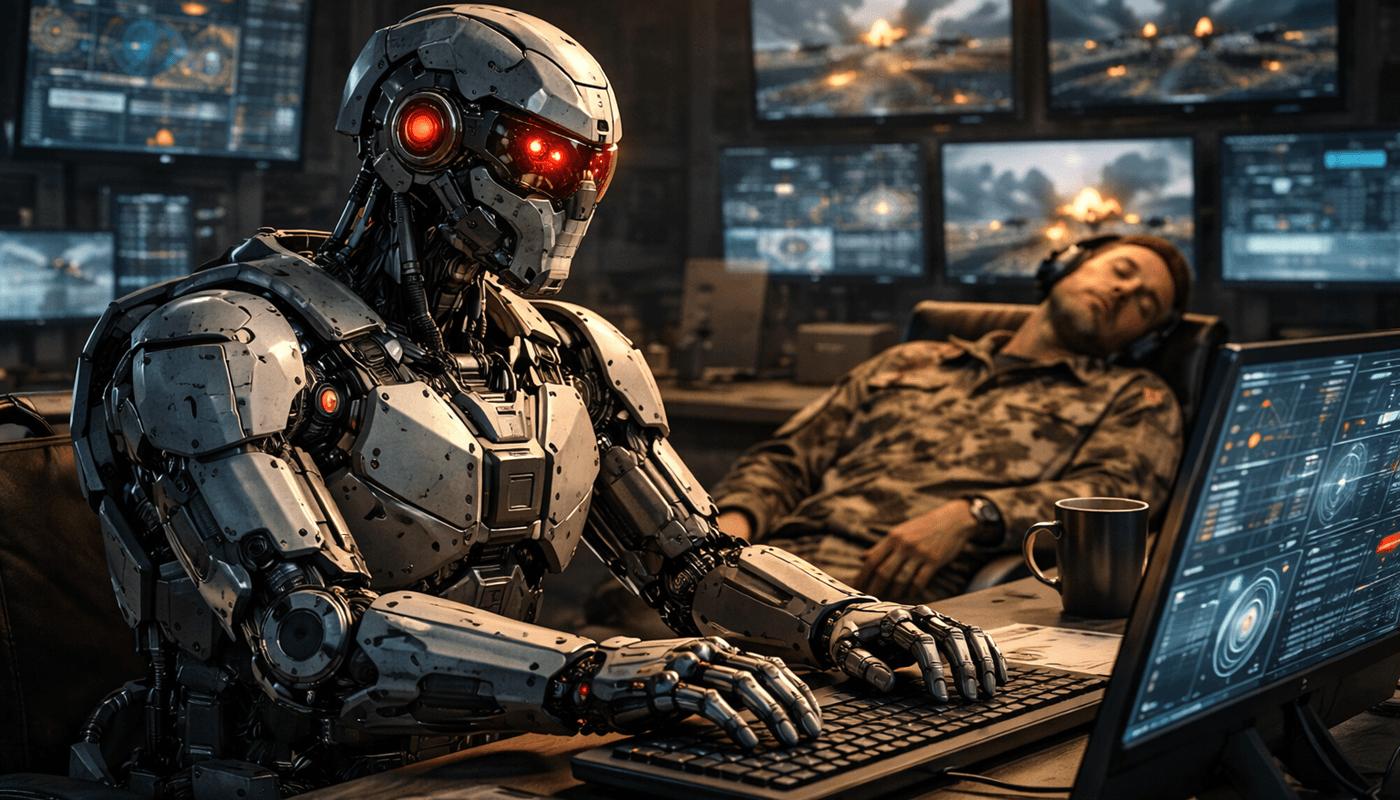

- Especialista señaló que la inteligencia artificial puede acelerar operaciones militares y reducir la supervisión humana en decisiones críticas

- Sistemas de IA ya analizan imágenes satelitales y datos de inteligencia para seleccionar posibles objetivos militares en conflictos recientes

El uso de Inteligencia Artificial en operaciones militares debería ser ampliamente documentado y debatido, ya que estas tecnologías podrían estar participando en decisiones que afectan directamente la vida humana sin suficiente supervisión de expertos, afirmó el Dr. Alexandro López González, coordinador de la nueva Ingeniería en Inteligencia Artificial de la Universidad Iberoamericana.

López González señaló que en conflictos recientes los sistemas de inteligencia artificial han comenzado a analizar grandes volúmenes de información militar —como imágenes satelitales o datos de vigilancia— para identificar posibles objetivos.

El académico explicó que esta capacidad permite procesar información a una velocidad imposible para los analistas humanos: “Algo que un analista hubiera hecho durante meses, ahora la inteligencia artificial puede hacerlo en horas”.

IA acelera decisiones militares

Este tipo de herramientas ya se utilizan en proyectos militares como Project Maven, un programa del Departamento de Defensa de Estados Unidos que aplica aprendizaje automático para analizar grandes volúmenes de imágenes y datos de inteligencia con el fin de identificar posibles objetivos militares.

En conflictos recientes, sistemas similares han sido utilizados para analizar fotografías satelitales, identificar infraestructura militar o sugerir blancos potenciales, lo que permite acelerar de forma significativa la planificación de operaciones.

Según López González, esta capacidad tecnológica puede transformar la dinámica de la guerra: “Un golpe militar que antes hubiera requerido meses de análisis ahora puede planearse en días o incluso en horas”.

Sin embargo, esta velocidad también genera preocupaciones sobre el nivel de supervisión humana en las decisiones finales.

La IA en el campo de batalla

El uso de estas herramientas ha generado debate internacional porque pueden difuminar la responsabilidad cuando ocurren errores o muertes civiles, además de reducir el tiempo disponible para revisar decisiones militares.

Especialistas han advertido que la automatización del análisis de inteligencia podría facilitar ataques más rápidos, aumentar el número de objetivos seleccionados y, en algunos casos, incrementar el riesgo para la población civil.

Cuando un algoritmo puede decidir sobre la vida humana

López González señaló que uno de los dilemas éticos más preocupantes es la posibilidad de que algoritmos participen en la selección de objetivos que después son atacados militarmente.

En algunos escenarios recientes, el análisis automatizado de datos ha sido utilizado para sugerir blancos militares a partir de imágenes satelitales y otras fuentes de inteligencia.

El académico advirtió que el problema no es únicamente tecnológico, sino también ético y político: “Cuando permites que un algoritmo participe en la selección de objetivos militares, estás acercándote a un escenario en el que un sistema puede influir en decisiones sobre la vida humana”.

Esto plantea interrogantes sobre quién es responsable cuando un sistema de inteligencia artificial se equivoca: los desarrolladores de la tecnología, los militares que la utilizan o las instituciones que la autorizan.

Una nueva carrera tecnológica militar

El uso de inteligencia artificial también ha abierto una nueva dimensión en la carrera armamentista global.

Según López González, los países no solo desarrollan inteligencia artificial para analizar objetivos, sino también estrategias para engañar a los sistemas enemigos, lo que podría intensificar los conflictos. Esto incluye tácticas diseñadas para confundir a los algoritmos mediante información falsa o señales engañosas que aparentan ser infraestructura militar.

El académico advirtió que esta dinámica podría acelerar la escalada tecnológica en los conflictos armados.

Formar especialistas con responsabilidad ética

Ante este escenario, López González subrayó la importancia de formar especialistas capaces de comprender tanto el potencial como los riesgos de la inteligencia artificial. Con ese objetivo, la Universidad Iberoamericana lanzó su Ingeniería en Inteligencia Artificial, un programa académico que busca preparar profesionistas con formación técnica, ética y social.

El plan de estudios incluye asignaturas como filosofía de la inteligencia artificial, ética de la inteligencia artificial, estudios sociales de la tecnología y gobernanza de la inteligencia artificial, con el objetivo de que los futuros ingenieros comprendan el impacto de estas tecnologías en la sociedad.

Las personas interesadas en estudiar esta licenciatura pueden iniciar su proceso de admisión a través del área de Preuniversitarios de la Universidad Iberoamericana, donde reciben orientación sobre becas, requisitos de ingreso y el proceso de inscripción.